Saludos SEO, Harold otra vez por aquí. En la guía anterior mostré cómo encontrar los problemas de rastreo que puede tener tu web.

Así como los problemas de rastreo evitan que la web sea procesada para la indexación, los problemas de indexación conllevan a que tu web, aunque este bien, no aparezca como debe en los resultados de búsqueda.

En esta entrega voy a mostrar cómo encontrar los problemas de indexación. Vamos a ello, no es complicado.

Si tienes un inventario de URL (si no sabes que es, puedes leer el primer artículo de esta guía sobre la iniciación en Screaming Frog), ya que te ayudará a poder identificar que tan grave puede ser un error de rastreo según la indexabilidad y el contenido de las URL con problemas.

Encontrando problemas de Indexación

Lo primero que vamos a chequear es como está la indexación de la web, para eso vamos a ver algunos datos de diferentes lugares para sacar una conclusión.

Recuerda que debes tomar nota(s) de los hallazgos en una hoja de calculo como la que dejo al final. Cada vez que leas «anota» me estoy refiriendo a esto.

1.1 Indexación en el buscador

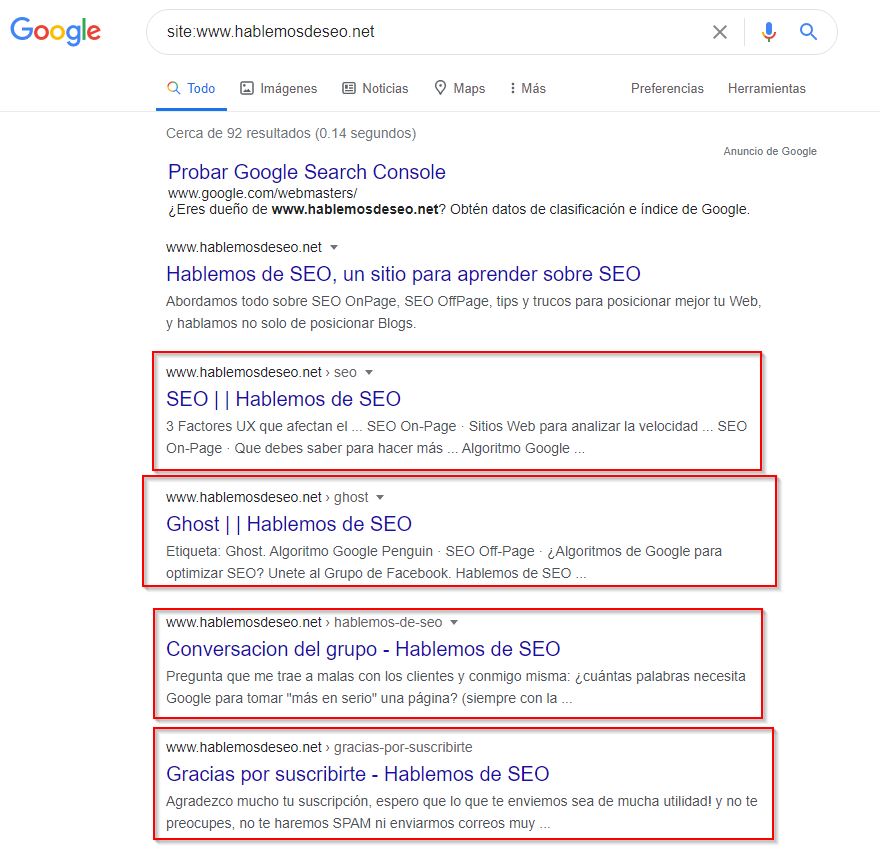

- Con el comando SITE: ve a Google y obtiene cuantas URLs indexadas tiene el dominio que estas analizando. En mi caso es site:www.hablemosdeseo.net (lo hago así pues está el foro del grupo en comunidad.hablemosdeseo.net) ve a la última página (del paginador de Google Search) y si te aparece un mensaje como este, haz clic sobre el enlace:

En mi caso obtengo 65 resultados.

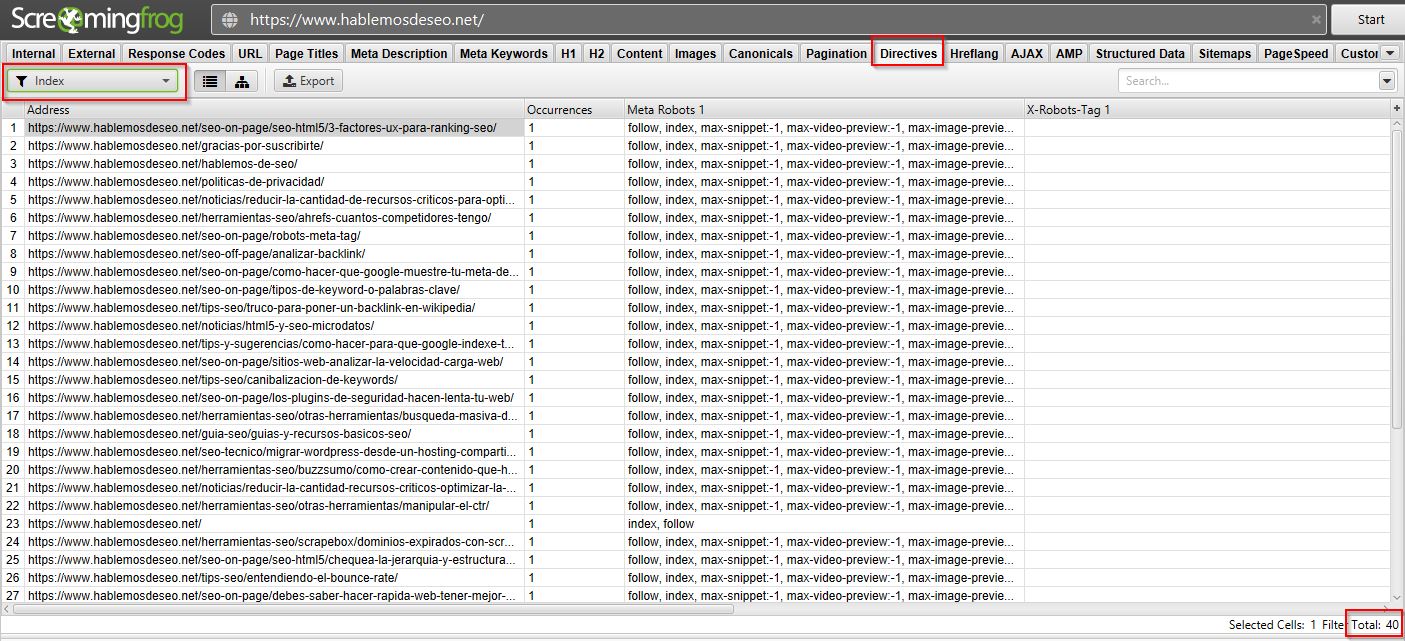

NotaEl comando site no es exacto y puede variar el número de resultados por diversas razones, inclusive sin hacer cambio alguno. Tómalo sólo como una aproximación - Ahora revisemos cuantas paginas rastreadas tiene Screaming Frog que sean indexables, para esto te vas SF > Directives > Filtras por INDEX y anotas, en mi caso son 40 URLs.

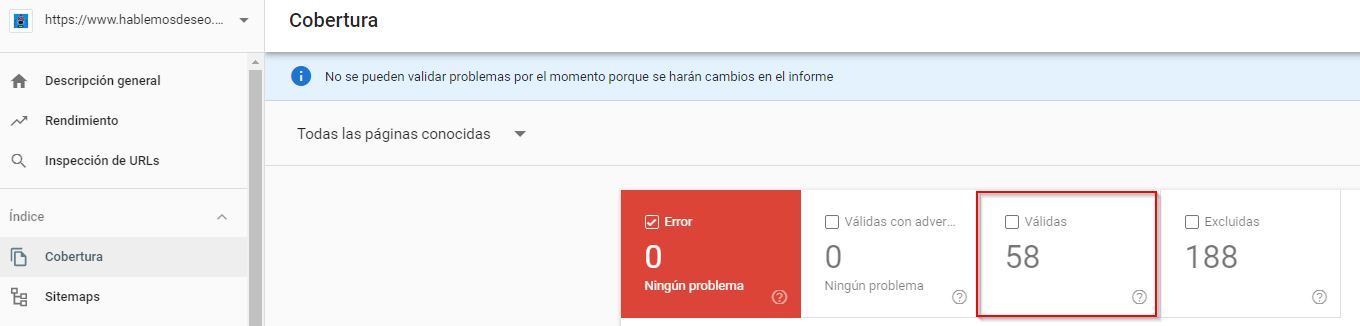

- Ahora comprueba cuántas URLs tiene indexadas Google en Google Search Console, para esto ve a GSC > Cobertura > Válidas y anota, en mi caso son 58 URLs.

- Si tu web tiene un Sitemap válido y lo has enviado a GSC, puedes continuar con los siguientes datos, de lo contrario puedes saltarlo.

1.2 Sitemap

-

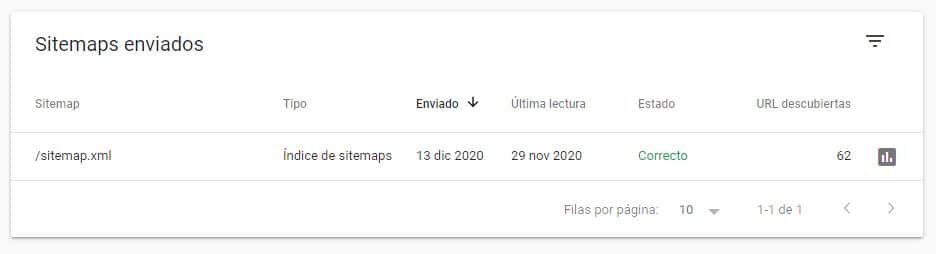

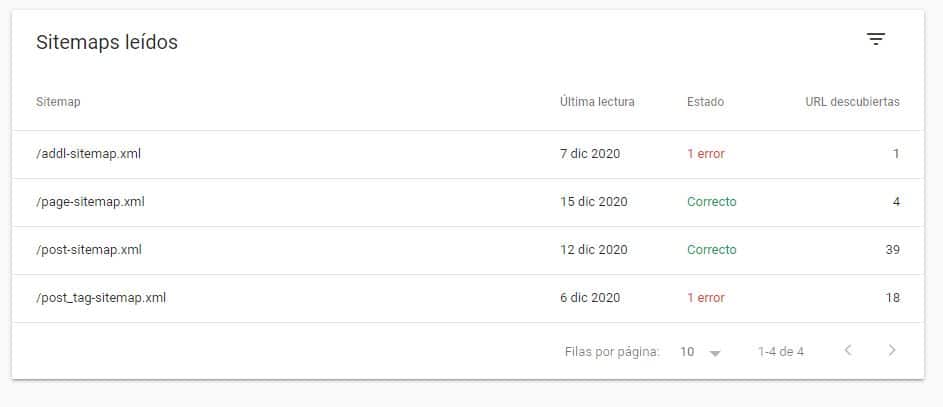

- URLs en el sitemap en GSC: Para esto ve a GSC > Sitemaps > y chequea cuántas URLs aparecen, en mi caso son 62 URLs.

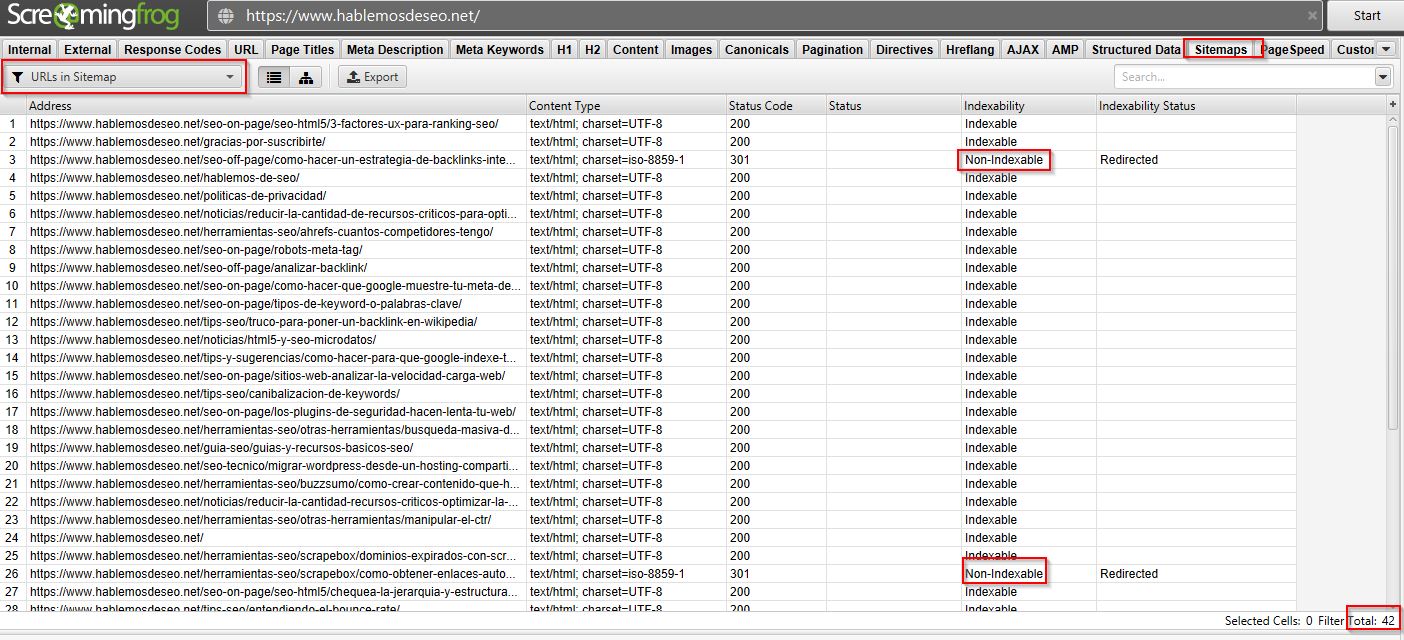

- URLs en el sitemap según Screaming Frog: Ve a SF > Sitemaps y filtra por URLS in Sitemap. En mi caso son 42.

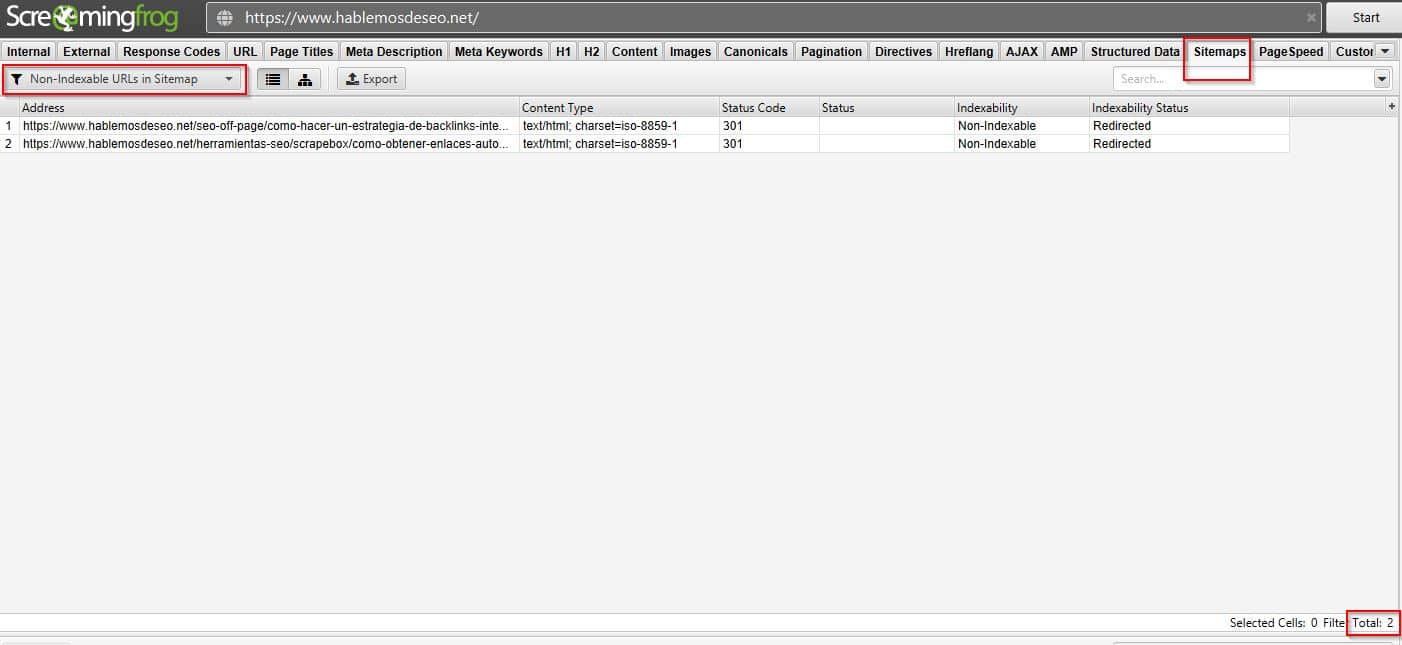

- URLs no indexables en el sitemap: ahora vamos a buscar si en el sitemap tenemos URLs que son no indexables, si ves la imagen anterior te das cuenta que de entrada pude ver 2. Para ver el total ve a SF > Sitemaps > y filtra por Non-Indexable URLs in Sitemap. En mi caso al final son 2 URLs, que tienen redirección 301.

- Ahora veamos las URLs que se han rastreado con Screaming Frog y que no están en el Sitemap, para esto te vas a SF > Sitemaps y filtra por URLs not in Sitemap, en mi caso no tengo URLs bajo estas condiciones.

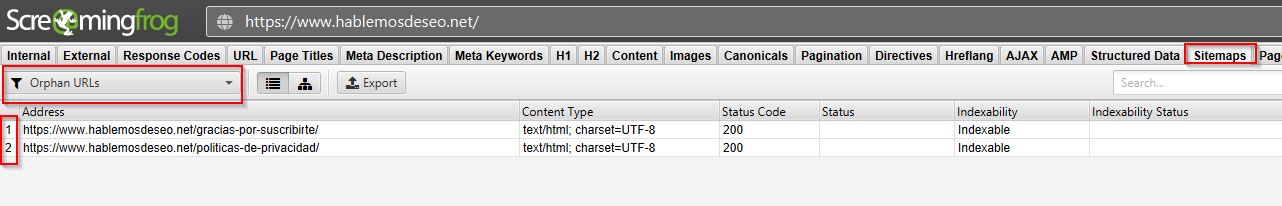

- URLs huérfanas: verifiquemos si hay URLs huérfanas en el Sitemap, es decir, URLs que están en el sitemap pero que no han sido rastreadas por Screaming Frog siguiendo los enlaces internos de la web. Esto puede suceder por un mal enlazado interno o simple error de dedo. Para encontrarlas te vas a SF > Sitemaps y filtras por Orphan URLs, en mi caso aparecen 2:

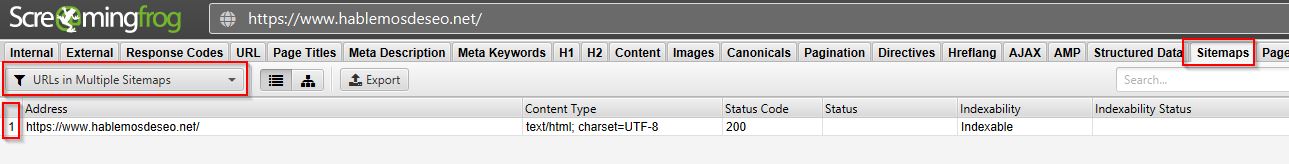

- URLs en varios sitemaps: ahora busquemos URLs que puedan estar en varios sitemaps. Te podras estar preguntando porque podrías tener varios sitemaps, y es que dependiendo del sitio y de cómo se construya el sitemap, lo más recomendable es partirlo según el contenido, por lo tanto, una URL no debería estar en más de un sitemap. Para ver estas URLs ve a SF > Sitemaps y filtra por URLs in Multiple Sitemaps, en mi caso aparece una, la homepage y en este caso no es un problema, debes considerarlo un problema cuando la URL sea otra y no la home.

- URLs en el sitemap en GSC: Para esto ve a GSC > Sitemaps > y chequea cuántas URLs aparecen, en mi caso son 62 URLs.

1.3 Robots y Meta Robots

- Exclusión de URLs en el robots.txt: ve a SF > Response Codes y filtra por Blocked by Robots.txt y anota, en mi caso no tengo

- URLs bloqueadas según GSC: Ve a GSC > Cobertura > Error > robots.txt ha bloqueado la URL enviada, en mi caso no tengo.

- URLs excluidas por robots.txt según GSC: Ve a GSC > Cobertura > Excluidas > bloqueada por robots.txt, en mi caso no tengo.

- Meta robots NOFOLLOW: Ve a SF > Directives y filtra por NOFOLLOW.

- Paginas que deberían ser NOINDEX: Si tienes páginas que deberían ser NOINDEX y están indexables, por ejemplo, los legales, carrito, gracias por tu compra, etc. Puedes ir a SF > Directives y filtra por Noindex, en mi caso todo está bien.

Existen otros datos que pudieran darte más información, pero a nivel básico creo que con esto es suficiente.

1.4 Conclusiones de la Indexación

Ahora saquemos conclusiones y recomendaciones a partir de la data que hemos obtenido.

- Hay una diferencia bastante relevante entre las URLs que aparecen en Google, las abiertas a indexación, las indexadas según Google en GSC, por lo tanto, es necesario revisar y comparar estas URLs para encontrar las diferencias y decidir la acción, las cuales pueden ser corregir el sitemap, eliminar URLs indexadas en Google, etc.

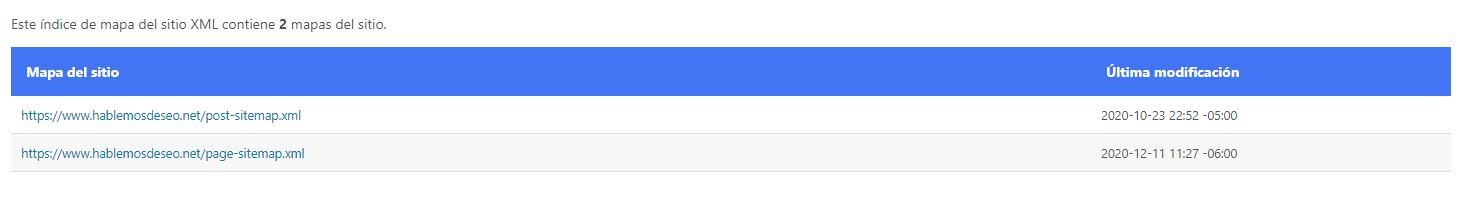

Esta corrección la hare después de corregir lo más urgente. - Se deben revisar los sitemaps, ya que Google tiene más URLs en el sitemap de las que lee Screaming Frog. Se deben encontrar las diferencias y tomar acción según cada caso. Para esto abre cada Sitemap en el navegador (o descárgalo) y revisa las URLs en cada sitemap en GSC explorando cada uno y viendo sus URLs.

Esta corrección la hare después de corregir lo más urgente. - Se tienen que remover las URLs no indexables del sitemap. En mi caso solo selecciono las URLs y veo hacia donde apunta la redirección en el tab inferior “URL Details” y veo que ambas URLs las he redireccionado a Easybacklink. Cada caso va a tener una solución y forma de ejecutar la solución diferente, en mi caso esas redirecciones ya tienen un buen tiempo asi que puedo poner las URLs en NOINDEX para que ya no aparezcan en el sitemap.

- Habían 2 URLs huérfanas, vamos a revisarlas y tomar acción, en mi caso son la página de gracias por suscribirte al newsletter y las políticas de privacidad, ambas deberían ser NOINDEX, y de esta forma también las quito del sitemap.

Ahora que he corregido el punto 3 y 4 procedo a revisar los otros puntos. Lo primero que haré es revisar el nuevo sitemap y si esta como yo espero, lo voy a subir nuevamente a GSC.

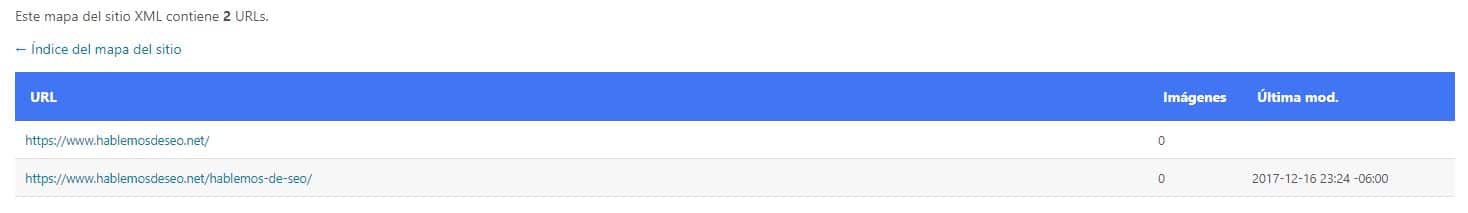

Voy a ver el de páginas primero ya que sé que en este sitio casi no hay páginas, y me encuentro esto:

Tengo una página donde está el Feed del grupo de Facebook, como conozco bien la web, sé que por un lado esta página no aporta valor y por el otro lado, desde las actualizaciones de FB he perdido conexión con dicho feed, así que esta desactualizado, no vale la pena tenerlo indexado por el momento, procederé a ponerlo en NOINDEX y asegurarme de que desaparezca la URL del sitemap.

Ahora reviso el sitemap de posts, y me aparecen 39 URLs las cuales verificó y aparentemente esta todo bien. Así que procedo a cargar el sitemap a GSC.

En este momento que he subido el nuevo sitemap me estoy percatando de que tengo subido un sitemap antiguo en GSC (sitemap.xml) de cuando usaba el plugin ALL IN ONE SEO y que luego migre a Rank Math, por lo tanto también voy a proceder a eliminar dicho sitemap de GSC.

Debido al tiempo que GSC toma en leer y procesar el nuevo sitemap, voy hacer una pausa en esto y revisare otros puntos.

Voy a proceder a revisar la lista obtenida de site:www.hablemosdeseo.net y revisar dichas URLs para checar que lo que esta es lo que debería, teniendo en cuenta que solo es una aproximación.

Lo primero que noto son URLs como estas que son TAGs o páginas que acabo de poner en NOINDEX así que he decidido quitarlas de los resultados de búsqueda ya que no aportan valor y es thin content. Para asegurarme, abro cada URL y verifico si están en NOINDEX, si no lo están procedo a ponerlas en NOINDEX y solicitó retirarlas de la URL yendo a GSC > Índice > Retirada de URLs, ten cuidado con esto, debes estar seguro de que realmente necesitas sacar dicho contenido.

Si no sabes cómo solicitar retirar la URL de los resultados de búsqueda, déjame un comentario y tratare de explicarlo mejor.

Después de recorrer todos los resultados veo un archivo adjunto que está disponible para descargar en un post sobre ScrapeBox, así que procederé a checarlo, ponerlo en NOINDEX y retirarlo del índice.

Si no se me paso nada por alto, esto es todo lo que he descubierto con la revisión de la indexación. Debo esperar unos días para rastrear de nuevo el sitio y volver a hacer este punto de la auditoría para verificar el resultado.

Qué has aprendido hoy

- Analizar problemas de indexación auxiliándose del Sitemap

- Encontrar problemas de indexación con Google Search Console

- Encontrar problemas de indexación con Screaming Frog

- Encontrar problemas de indexación por configuración en el Robots y Meta Robots.

Esto ha sido todo por hoy, si te ha gustado lo que has aprendido, compártelo o házmelo saber en los comentarios. También, si tienes alguna duda o consulta, dejala en la caja de comentarios, siempre los reviso y será un placer ayudarte si puedo.

En este enlace te dejo el archivo de excel que cubre esta parte de la auditoría para que te sirva de referencia y tengas donde anotar lo que encuentres en tu web.

Ahora procederemos con otro punto de la auditoría.